Door Simon Been

Wat is de impact van AI op het informatiedomein? In een reeks artikelen wordt ingegaan op veranderingen in de organisatieprocessen, de informatieprofessie en het persoonlijke informatiewerk ten gevolge van kunstmatige intelligentie. In deze zeventiende aflevering – deel 1 van een tweeluik – draait het om de ultieme AI-ontdekkingsreis waar niemand onderuit komt: het leren dealen met de illusie van 100 procent controle.

Het lijkt net zo makkelijk als fietsen, maar voordat je als beginner op je zadel verantwoord door Amsterdam manoeuvreert, zijn er echt de nodige leermijlen af te leggen. Zeker als de fiets, de verkeersregels én de routes dagelijks lijken te veranderen. Maar dan nog: is het sowieso wel haalbaar dat jij altijd ‘in control’ bent? Echt niet. Hoe beperk je dan de risico’s zoveel mogelijk? Zeker als informatieprofessional heb je een meer dan gemiddeld belang bij de betrouwbaarheid van reis en bestemming. Kortom, verantwoord AI-gebruik draait om het goed verdelen van je aandacht: wanneer kan ik de teugels laten vieren en wanneer moet ik ‘erbovenop zitten’? Dat is de focus van dit deel 1. In de volgende IP belicht deel 2 praktische handvatten om meer ‘in control’ te zijn.

Rekbaar begrip

‘Je gebruikt AI? Doe je dat wel verantwoord?’ Je hoort het veel, maar wat betekent dat woord precies? We weten heel goed: je moet altijd checken wat je erin stopt, wat je vraagt en wat je eruit krijgt. Altijd de regie voeren. Elke organisatie heeft na twee jaar studeren wel een variant daarop. Sommige spelregels zijn vaak goed hanteerbaar zoals ‘geen persoonsgegevens’ en ‘geen DeepSeek’, maar ‘jij controleert alles’ en ‘jij besluit altijd’ zijn veel te kort door de bocht.

Kijk maar: je laat ChatGPT of Copilot een beknopt stukje voor een interne nieuwsbrief schrijven over een aankomend project: Maak van deze korte projectbeschrijving een luchtig nieuwsberichtje voor intern gebruik (150 woorden max). AI levert binnen een paar seconden een tekst aan die precies goed voelt: helder, enthousiast, vriendelijk van toon. Je leest het even door, past één naam aan en plaatst het zo in de nieuwsbrief. Prima. Waarom? Omdat de gevraagde taak nauwelijks complex is en de externe risico’s ontbreken. Jouw rol van lichte toetsing – meelezen maar amper bijsturen – volstaat.

Maar het kan ook zo …

Je vraagt ChatGPT of Copilot: Maak van deze beleidsnotitie over fietsinfrastructuur een publieksvriendelijke samenvatting in maximaal 300 woorden. Binnen vijf seconden ligt er een keurig antwoord. Lekker vlot geschreven, kort en krachtig. Je bent eigenlijk onder de indruk. Tot je het écht gaat lezen. Dan merk je: er mist nuance, sommige cijfers zijn wel genoemd maar uit hun verband gehaald, en de tone of voice is iets té enthousiast voor een notitie die juist voorzichtig wil afstemmen met verschillende partijen. Dat leidt tot een belangrijk vraagstuk (en het betreft niet eens de kwaliteit van de AI):

- Wat bepaalt eigenlijk hoe scherp je moet zijn bij het werken met AI?

- Wanneer is een simpele opdracht écht simpel?

- Wanneer moet je alert zijn op vertekening, overdrijving, versimpeling of zelfs misleiding?

Wat gaat hier mis?

Als we deze situatie even ontleden zien we drie factoren die bepalend zijn:

1. De complexiteit van de taak

Het lijkt een simpele samenvatting, maar in werkelijkheid moest AI de essentie van een politiek gevoelige notitie samenvatten, het jargon eruit filteren én het publiek informeren zonder de balans te verstoren. Dat is helemaal niet zo simpel.

2. De fase in het informatieproces

Je vroeg dit aan het eind van het proces: de tekst lag er al. Je zat in de fase van communiceren, presenteren en delen. Juist daar ligt reputatierisico op de loer. Een foutje in een interne analyse is vervelend. Maar een fout in een externe publicatie? Pijnlijk.

3. Jouw eigen rol in dit proces

Je gaf één opdracht, keek mee, maar stuurde niet bij. Je vertrouwde op de output. Daar is niets mis mee, zolang je weet of dat in de specifieke situatie verstandig is. Hier niet dus.

Toch verschilt de vraag nauwelijks van die in het vorige voorbeeld waar een lichte toetsing volstond. Dit geeft aan: hoe vergelijkbaar situaties op het eerste gezicht ook lijken, qua risico kunnen ze sterk verschillen. Het echte risico ligt niet zozeer bij de AI, maar bij jouw eigen inschatting: in welke situaties moet jij scherp zijn? En waar kun je AI haar gang laten gaan?

Aanpak om situaties te onderscheiden

Het is tijd voor een hanteerbaar denkkader. Wanneer kun je freewheelend chatten, wanneer zet je je politiepet op en wanneer activeer je je innerlijke prompt-magiër? Ook kan zo’n kader je helpen om keuzes beter te kunnen uitleggen (aan collega’s of opdrachtgevers). Er zijn vele modellen in omloop en ze lijken allemaal wel op elkaar, maar de invalshoeken zijn verschillend. Sommige focussen op je eigen intenties (AI als inspiratiebron, zoekmachine, redactiepartner, sparringpartner, producent of zelfs taakrobot), andere op de functies die je AI geeft (produceren, transformeren, interpreteren, ordenen, adviseren, automatiseren). Hieronder focussen we op risico’s en benodigde aandacht en regie.

De ingrediënten zijn deels al genoemd:

- Het Vraag- en Antwoordspel

- De complexiteit van je vraagstuk

- In welke stap van het informatieproces je zit

- Welke aandacht en toezicht vereist kunnen zijn

A. Het Vraag- en Antwoordspel

Iedereen weet inmiddels: je moet kritisch zijn. Maar waarop en wanneer? In de praktijk betreft dat drie aandachtspunten:

1. De input – wat je erin stopt

De vraag. Hier bepaal jij de spelregels. Je geeft context, stelt grenzen, formuleert wat je verwacht. Een AI gaat bij alles uit van een soort default, een gemiddeld antwoord voor een gemiddelde gebruiker. Naarmate ze meer over jou weet zal dat bijkleuren, maar er zijn zoveel nuances en misschien heb jij wel meerdere petten, dus als je maatwerk wilt, zul je dat in je vraagstelling moeten inbakken. Als je hier te weinig aandacht aan geeft, is de kans groot dat AI gaat afdwalen of verzint wat jij niet gevraagd hebt.

Let hier extra goed op als:

- De taak inhoudelijk complex is (bijvoorbeeld gevoelig, politiek, meerduidig).

- AI werkt met documenten die je meestuurt, maar die niet vanzelfsprekend zijn (denk aan incomplete beleidsnotities, e-mails, notulen).

- Je afhankelijk bent van consistentie of juridische/beleidsmatige juistheid.

2. De output – wat je uiteindelijk krijgt

Soms zit het gevaar niet in wat je vraagt, maar in hoe overtuigend AI iets presenteert. Een foute conclusie, verpakt in een mooie tekst, lijkt al snel betrouwbaar. Juist dan moet je alert zijn op verdraaiing, framing of missende nuance.

Let hier extra goed op als:

- Je de output gaat publiceren of delen buiten je eigen team.

- Het om gevoelige onderwerpen gaat met publieke of bestuurlijke impact.

- De tekst makkelijk scanbaar is (want dan mis je de subtiele fouten sneller).

3. Het proces – wat je onderweg doet

Aandacht voor input en output ligt voor de hand, maar onderschat vooral het belang van het proces niet. AI werkt iteratief. Een goede sessie ontstaat vaak niet in één keer. Als je denkt: ‘Het antwoord is (nét) niet goed, maar ik zie wel waar het heen moet’, zit je in de procesfase. Dan is bijsturen cruciaal.

Let hier extra goed op als:

- De opdracht complex is en meerdere denkstappen vraagt.

- AI zelf moet structureren, analyseren of interpreteren.

- Je merkt dat er vertekening insluipt, maar je wilt het toch verder verkennen.

Waarom dit belangrijk is

Deze drie momenten komen in élke AI-opdracht terug. Soms is alleen de output belangrijk. Soms moet je vooral de input scherp krijgen. En bij complexe taken zit het venijn in de hele keten. De volgende onderwerpen helpen om helderder te krijgen waar en wanneer die risico’s het grootst zijn.

B. De complexiteit van je vraagstuk

We zagen het al: niet elk AI-verzoek is gelijk. Sommige vragen zijn eenvoudig, andere zijn complex. De mate van complexiteit is een van de belangrijkste factoren die bepaalt hoeveel regie en aandacht jij als gebruiker moet inzetten.

Waarom is complexiteit relevant?

- Hoe complexer het vraagstuk, hoe groter de kans op misinterpretatie door AI.

- Hoe complexer de taak, hoe belangrijker het wordt dat jij als gebruiker stuurt, verduidelijkt, bijstuurt en toetst.

- Bij eenvoudige taken kun je vaker volstaan met lichte toetsing, maar bij complexe taken moet je actief regie voeren op alle fasen van de interactie.

Complexiteit is dus een schaal. Laten we drie niveaus hanteren – laag, gemiddeld en hoog – die hopelijk herkenbaar, hanteerbaar en voldoende onderscheidend zijn. Realiseer je wel dat dit maar één van de factoren is die risico’s blootleggen. En dat complexiteit óók te maken heeft met context.

1. Lage complexiteit: afgebakend en direct

Dit zijn vragen of taken met een duidelijke scope en een beperkt aantal variabelen met een laag gewicht. Denk aan het voor eigen gebruik herschrijven van een tekst in eenvoudig Nederlands, het samenvatten van een kort artikel of het uitleggen van een begrip.

- AI kan dit soort taken doorgaans zelfstandig goed uitvoeren, zolang de opdracht helder is. De resultaten zijn vaak voorspelbaar en bruikbaar zonder veel interactie. Risico? De kans op fouten of vertekeningen is relatief klein, maar niet nul.

2. Gemiddelde complexiteit: meerdere stappen of perspectieven

Hier gaat het om taken waarbij meerdere elementen samenkomen. Bijvoorbeeld het vergelijken van twee beleidsopties, het maken van een eerste opzet voor een rapport of het herstructureren van een interviewverslag.

- AI is in staat om overzicht te creëren, verbanden te leggen of structuur aan te brengen. Risico? De kans op misinterpretatie of ongewenste simplificatie neemt toe. De output is minder voorspelbaar en vraagt mogelijk meer toetsing.

3. Hoge complexiteit: abstract, strategisch of gevoelig

Deze vragen raken aan belangen, strategische keuzes, ethiek of contextgevoelige oordelen. Denk aan het opstellen van beleidsrichtlijnen, het analyseren van tegenstrijdige documenten of het voorbereiden van een externe communicatie bij een incident.

- AI kan opties genereren, scenario’s aandragen of argumenten ordenen. Maar de resultaten zijn sterk afhankelijk van de context die jij aanlevert. De AI zelf begrijpt geen belangen, nuance of intentie. Risico? De kans op onvolledige of scheefgetrokken uitkomsten is significant. Er is een reëel risico op misleidende logica of onbedoelde vertekening van het vraagstuk.

Complexiteit is contextueel

Een ogenschijnlijk eenvoudige taak kan alsnog complex worden als:

- Je werkt met vertrouwelijke of gevoelige informatie.

- Het resultaat veel impact blijkt te hebben.

- Het nodig is steeds meer context toe te voegen.

- Er meerdere stakeholders betrokken zijn.

- Je simpelweg veel voortschrijdend inzicht krijgt en de scope verbreed, versmald of verlegd raakt.

Onder de oppervlakte van ‘een simpele vraag’ kunnen variabelen met een zwaar gewicht schuilen die direct hogere complexiteit aangeven. Complexiteit is dus niet alleen een eigenschap van de opdracht, maar ook van de bredere situatie en het vraag- en antwoordproces. In twijfelgevallen: ga uit van het hogere niveau.

C. Jouw plek in het informatieproces

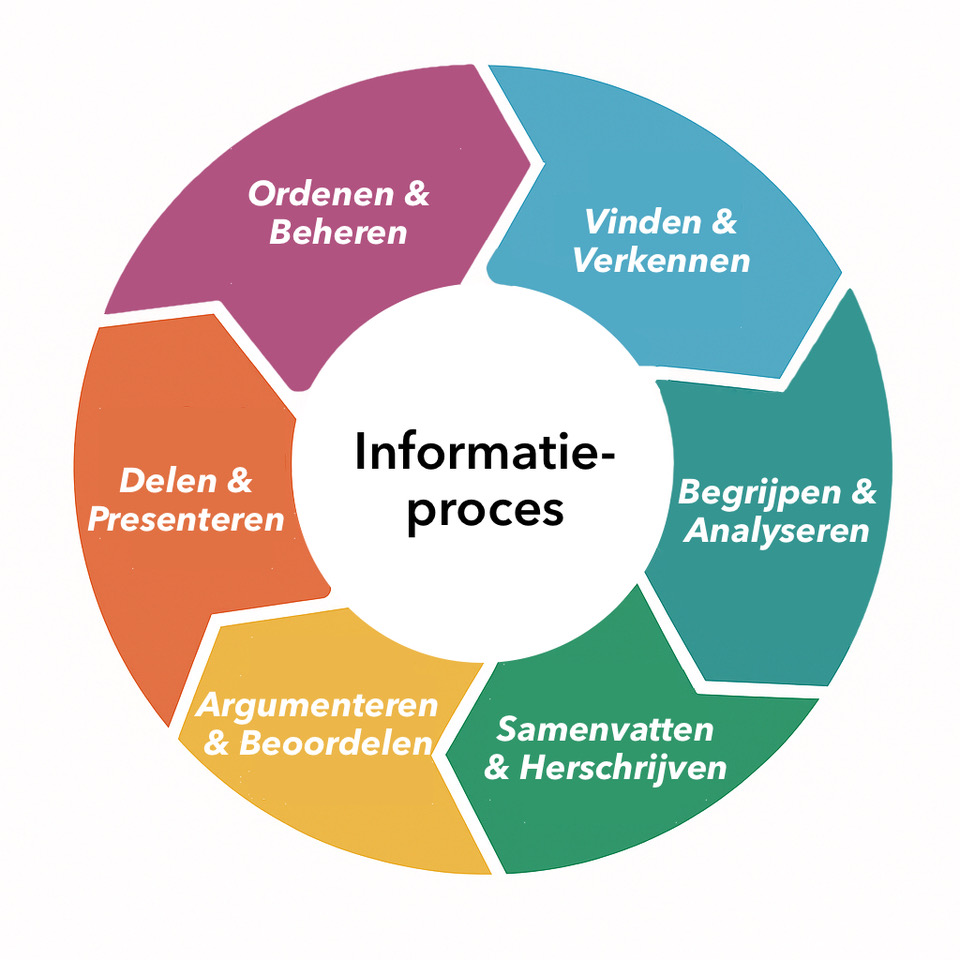

De inzet van AI is dus niet overal even risicovol. Het maakt nogal wat uit of je de AI vraagt om losse ideeën te genereren voor een poster of om een samenvatting te maken van een juridisch beleidsstuk. Hetzelfde geldt voor de plek in je werkproces: ben je nog aan het verkennen of ben je al iets aan het publiceren? Dat informatieproces kun je indelen in zes herkenbare fasen:

Fase 1. Vinden & Verkennen

In deze beginfase oriënteer je je op een onderwerp, probleem of vraag. Je zoekt informatie, voorbeelden, invalshoeken of bestaande content. Dat kan feitelijk en gericht zijn (‘Wat staat er in dit rapport?’) of juist open en verkennend (‘Wat zijn mogelijke oplossingen?’). De kracht van AI ligt dan in snelheid, suggesties, invalshoeken, termen, feitjes of vragen.

De regiedruk ligt in deze fase vooral op de input. Als je niet scherp formuleert, vult AI jouw bedoeling zelf in. En dat is funest in deze fase, want dan bepáált AI jouw richting van denken voor het hele informatieproces. Het risico is dat je een kant wordt opgestuurd zonder het door te hebben: een ogenschijnlijk neutrale start die je hele denkproces kleurt. Complexiteit maakt het erger als het onderwerp gevoelig, politiek of strategisch is. Dan kan framing of bias van AI je hele verkenning besmetten.

Fase 2. Begrijpen & Analyseren

In deze fase probeer je grip te krijgen op de inhoud. Je probeert verbanden te zien, de kern te vatten, een redenering te volgen of meerdere bronnen te interpreteren. AI kan hierbij ondersteunen door te structureren, samen te vatten, te rubriceren of logica bloot te leggen.

De regiedruk ligt hier vooral op het proces. AI kan prima analyseren of rubriceren, maar doet dat vanuit aannames over relevantie of logica. Die aannames zijn niet altijd zichtbaar. Als je niet actief bijstuurt of doorvraagt, krijg je een schijnbaar logisch verhaal dat de verkeerde nadruk legt. Complexiteit versterkt het risico als het materiaal ambigu is of als meerdere interpretaties mogelijk zijn. Dan kan AI je te snel op één spoor zetten.

Fase 3. Samenvatten & Herschrijven

In deze fase wil je bestaande informatie compacter maken of in andere woorden weergeven, bijvoorbeeld begrijpelijker, bondiger of toegankelijker. AI is hier vaak op haar sterkst qua stijl, toon, opbouw en kortheid.

De regiedruk ligt vooral op de output. AI produceert hier vaak snel iets wat overtuigend oogt, maar inhoudelijk net niet klopt, nuance mist of te stellig is. Het risico zit dus in het doorslikken van een tekst die te goed lijkt. Complexiteit versterkt het risico als de oorspronkelijke tekst veel onderliggende nuance bevat of politiek gevoelig is. Dan kan herschrijven vervormen.

Fase 4. Argumenteren & Beoordelen

In deze fase draait het om het opbouwen, testen of afwegen van argumenten. Je wilt bijvoorbeeld AI laten meewegen, checken of iets logisch is, of sterke en zwakke punten tegenover elkaar zetten.

De regiedruk ligt in deze fase op zowel proces als output. AI redeneert snel en soepel, maar werkt vanuit plausibiliteit, niet vanuit bewijs. Het risico is dat AI aannames doet die logisch lijken, maar niet kloppen. Of dat jij zélf een stap overslaat omdat AI het al zo rond formuleert. Complexiteit vergroot het risico bij ethische, juridische of politieke afwegingen, waarbij belangen en definities een rol spelen.

Let wel op: het delen van informatie is op zich al risicogevoelig, maar dat geldt des te meer wanneer de output extern wordt gepubliceerd of een bestuurlijk/publiek effect heeft. De vereiste regie en controle kunnen dan snel toenemen – ook bij ogenschijnlijk eenvoudige taken.

Fase 5. Delen & Presenteren

In deze fase wil je output maken voor anderen: collega’s, bestuur, klanten, burgers. Het kan gaan om publicaties, beleidsnotities, samenvattingen of visualisaties. AI helpt dan met toon, opbouw en verwoording.

De regiedruk ligt vooral op de output, maar verschuift bij complexere situaties óók naar de input. Want als AI iets gaat verwoorden namens jou of jouw organisatie, dan moet de instructie kraakhelder zijn. Het risico is dat AI ‘namens jou’ een boodschap formuleert die net de verkeerde nadruk legt. Complexiteit vergroot het risico als de context gevoelig ligt of de boodschap extern wordt gedeeld.

Fase 6. Ordenen & Beheren

In deze fase breng je structuur aan in informatie: rubriceren, taggen, samenvatten voor archief of voorbereiden voor hergebruik. AI kan hier grote stappen maken in het reduceren van bulk en het zoeken van patronen.

De regiedruk ligt vooral op de input. Als je niet precies bent over de ordeningscriteria, vult AI zelf in wat belangrijk is en die keuzes zie je niet altijd terug. Het risico is dat je denkt dat iets correct is opgeslagen of samengevat, terwijl een cruciaal element buiten beeld is geraakt. Complexiteit maakt het risico groter als het gaat om grote volumes, diverse bronnen of inhoudelijke gevoeligheid.

D. Niveaus van menselijke regie en aandacht

Met de voorgaande stappen hebben we inmiddels een basis. Nu komen we bij de hamvraag betreffende jouw rol als gebruiker: hoeveel tijd en aandacht besteed jij idealiter aan het formuleren van de vraag, het sturen van het proces en het beoordelen van de output? Anders geformuleerd: hoeveel verantwoordelijkheid delegeer jij aan de AI? We zijn immers op zoek naar de illustere grens tussen veilige ondersteuning en onveilige uitbesteding. Eigenlijk gaat het over regie en macht, een uiterst gevoelig onderwerp dat toelichting vergt.

Verantwoordelijkheid versus regie

In overheidscontext (en steeds vaker ook daarbuiten) geldt het uitgangspunt: ‘De mens blijft eindverantwoordelijk.’ En dat is juridisch, beleidsmatig en ethisch volkomen terecht. Maar … er is een belangrijk verschil tussen verantwoordelijkheid en regie. Je kunt claimen dat jij als mens aan het roer staat en verantwoordelijk blijft, maar bewust of onbewust toch door AI gegenereerde beleidsanalyses in een notitie verwerken zonder een kritische toets op alle ins en outs van dat analyseproces. En dit zijn situaties die volop voorkomen om verschillende redenen. Het is naïef om het ideaalbeeld ‘altijd alles gecontroleerd hebben’ als realiteit te nemen. Sterker nog: dat is zo intensief dat het maar beperkt haalbaar is – wat wetgevers, directies en waakhonden ook zeggen. Je zult je tijd en aandacht dus moeten doseren en verdelen. Zie ook het kader ‘Disclaimer’.

Het is praktisch om ook rond de genodigde regie en aandacht een soort schaalverdeling te maken. Dit leidt tot vier niveaus:

Niveau 1. Passieve monitoring

De AI voert de taak zelfstandig uit, misschien automatisch of herhaald. Jij kijkt alleen achteraf (of helemaal niet).

- Input: is vaak generiek of hergebruikt.

- Proces: loopt zonder tussenkomst.

- Output: wordt niet planmatig beoordeeld, tenzij er iets opvalt.

- Regie/aandacht: minimaal.

Niveau 2. Globale toetsing achteraf

Je formuleert een opdracht en bekijkt het eindresultaat. Je leest globaal en grijpt alleen in bij opvallende fouten.

- Input: beknopt of abstract.

- Proces: AI werkt grotendeels zelfstandig.

- Output: wordt beperkt getoetst.

- Regie/aandacht: gemiddeld tot laag.

Niveau 3. Actieve begeleiding

De AI denkt met je mee op basis van jouw input. Je geeft richting, kiest wat bruikbaar is en begeleidt het verloop van het gesprek.

- Input: open of suggestief, met sturing.

- Proces: AI doet voorstellen, jij beoordeelt.

- Output: wordt actief gescreend en aangepast.

- Regie/aandacht: hoog.

Niveau 4. Volledige regie

Je stuurt elke stap van de interactie met AI: je formuleert gedetailleerde opdrachten, leest de output aandachtig en bewaakt het verloop van het proces.

- Input: sterk gestuurd, expliciet.

- Proces: volledig onder jouw controle.

- Output: wordt kritisch beoordeeld.

- Regie/aandacht: maximaal.

Het ordeningscriterium is dus: hoe actief en kritisch is de gebruiker betrokken bij instructie, bijsturing en toetsing?

Tot slot

Zo zie je maar: AI is net zo simpel als een fiets en je hoeft er niet eens voor uit je stoel te komen. En toch … de praktijk is weerbarstig. Maar dat ligt niet aan de AI. Net als elke hoogopgeleide stagiair heeft zij sturing nodig. Soms vooral direct als je een taak geeft, soms meer op andere momenten, maar vooral als het vraagstuk complex is of van groot belang voor vervolgactiviteiten. Sorry, of je het wilt of niet, je bent leidinggevende geworden. Zie dit artikel maar als een spoedcursus ‘waar en wanneer moet ik vooral alert zijn’. Tegelijkertijd is het een handige kapstok om in deel 2 praktische handreikingen aan op te hangen.

In de tussentijd: laat je niet ontmoedigen door teleurstellingen, AI is werk in uitvoering en wordt met de dag beter. Als ik dit schrijf zit ChatGPT al op de 224e versie, sec in 2025. Dus: creëer je eigen inzichten. Experimenteer hands-on. Verken de mogelijkheden en de keerzijdes. Je investeert in je eigen toekomst.

P.S. Dit is redelijk onontgonnen terrein, dus reacties zijn bijzonder welkom. Je kunt ze mailen naar redactie@informatieprofessional.nl.

De vorige afleveringen in deze serie lezen? Je vindt ze in het archief op informatieprofessional.nl (trefwoord ‘AI informatiedomein’).

Disclaimer

Het model dat ik hier voorstel – waarin we AI-gebruik plaatsen naar soort gebruik, fase in het proces en mate van regie – helpt je om structuur aan te brengen en helpt vooral ook om bewustwording te bevorderen. Maar zie het niet als gospel. Welke indeling je ook gebruikt, het blijft een oversimplificatie die de werkelijkheid geweld aandoet. Ook is het geen veiligheidscheck. Het beschermt je niet tegen de consequenties van een slechte prompt, verkeerd geselecteerd document of slordige toelichting. Alles draait om de kwaliteit van jouw interactie ermee.

Simon Been is directeur van het Papieren Tijger Netwerk en spreker/trainer/auteur over AI in het informatiedomein.

Deze bijdrage komt uit de papieren IP #6-2025. Het hele nummer kun je hieronder lezen of downloaden.